Apinat, laskimet ja LLM:t: Työkalujen ymmärtäminen ja niiden rajoitteet

![]() Jos annat apinalle laskimen, mitä odotat tapahtuvan? Apina ottaa laitteen käteensä, tutkii sitä hetken ja painaa todennäköisesti muutamia nappeja samalla. Tarkastelun päätteeksi laskimen näytölle ilmestyy tulos! Mitä tämä tarkoittaa? Osaako apina tehdä matemaattisia laskutoimituksia?

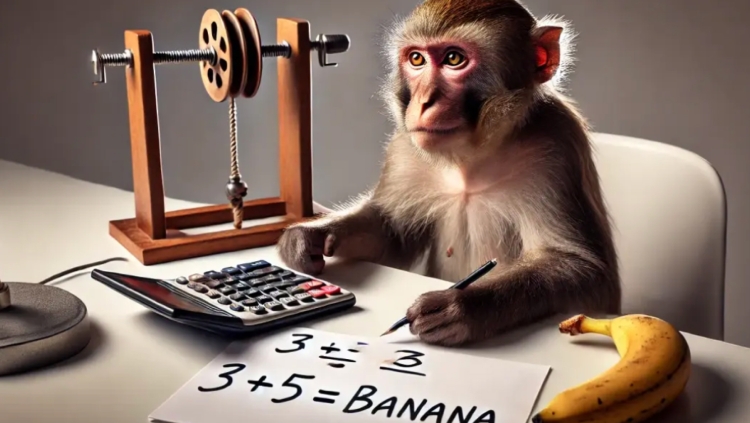

Jos annat apinalle laskimen, mitä odotat tapahtuvan? Apina ottaa laitteen käteensä, tutkii sitä hetken ja painaa todennäköisesti muutamia nappeja samalla. Tarkastelun päätteeksi laskimen näytölle ilmestyy tulos! Mitä tämä tarkoittaa? Osaako apina tehdä matemaattisia laskutoimituksia?

Vastaus tähän on itsestäänselvä: ei tietenkään. Satunnaisten numeroiden näppäily laskimeen ei tarkoita, että numeroita syöttävä apina osaisi matematiikkaa. Miten laskin sitten saa oikean vastauksen? Tarkoittaako tämä, että laskin ymmärtää matemaattisia käsitteitä?

Vastaus on jälleen ei. Laskin pystyy laskemaan, koska se on ohjelmoitu tekemään niin, mutta se ei ymmärrä matemaattisia käsitteitä.

Laskimen tuottaman vastauksen hyödyllisyys riippuu täysin käyttäjästä, joka syöttää luvut, sekä hänen kyvystään ymmärtää tulos. Apina voi syöttää laskimeen laskun 3 + 5 ja saada tulokseksi oikein 8, mutta apina ja laskin eivät kumpikaan ymmärrä, että 8 on suurempi kuin 3.

Toisaalta fyysikko laskimen kanssa pystyy helpommin selvittämään, kuinka paljon voimaa tarvitaan raskaan kiven nostamiseen taljalla. Fyysikko ymmärtää siihen liittyvät voimat, ja laskin helpottaa vastauksen löytämistä. Ilman fysiikan ymmärrystä apina laskimen kanssa ei koskaan pystyisi saavuttamaan samaa lopputulosta.

Tämä esimerkki on ilmeinen, ja silti olemme nyt tilanteessa, jossa meillä on suuria kielimalleja (LLM:t, kuten ChatGPT, Copilot jne.) LLM:t ovat hämmästyttävän vaikuttavia tarjoamaan tietoa jo valmiiksi ymmärretyistä käsitteistä. Jos kysyt LLM:ltä “miksi taivas on sininen?” tai “kaavaa voiman laskemiseksi esineen nostamiseen taljalla”, se antaa todennäköisesti oikean vastauksen. Mutta tarkoittaako tämä, että LLM ymmärtää näitä käsitteitä ja että se korvaa tutkijat ja fyysikot?

Vastaus ei ole yhtä ilmeinen, mutta se on silti ei. Kuten laskimet on ohjelmoitu tekemään laskutoimituksia, myös LLM:t on ohjelmoitu vastaamaan kysymyksiin tunnetuista käsitteistä. Yksinkertaistettuna LLM:n vastaukset perustuvat todennäköisyyslaskelmaan siitä, mikä on todennäköisin vastaus kysymykseen. LLM:n vastaukset on suunniteltu kuulostamaan inhimillisiltä, ja siksi niissä on vakuuttavia piirteitä, jotka luovat illuusion ymmärryksestä. LLM tietää, miksi taivas on sininen, koska tutkijat ovat jo tutkineet tätä aihetta kokeellisesti ja julkaisseet löydöksensä. Jos tutkijat eivät olisi selvittäneet, miksi taivas on sininen, LLM ei osaisi antaa oikeaa vastausta.

LLM:t ovat kuin laskin. Laskin pystyy tuottamaan oikean vastauksen, koska laskutoimitukset, joita laskin osaa tehdä, ovat jo ennalta ymmärrettyjä. Laskin ei tiedä, että “3 + 5 = 8”, eikä ymmärrä mitään itse yhtälöstä. Samoin LLM ei ymmärrä, miksi taivas on sininen, mutta se on ohjelmoitu löytämään todennäköisimmät sanat, jotka vastaavat kysymykseen.

Kuten laskin on työkalu ammattilaisen työkalupakissa, myös LLM on työkalu. LLM:t voivat auttaa ammattilaisia löytämään tietoa, tulkitsemaan dokumentaatiota, hiomaan koodia, tiivistämään tekstiä, luomaan kuvia ja paljon muuta, helpottaen heidän päivittäistä työtään. Ammattilaisen käsissä LLM on yksi lisätyökalu työn tehostamiseen, mutta LLM ei korvaa asiantuntijoita.